やること

前回に引き続きStyleGANで遊んでいます。

メタバースだとか言われますが、正直なところ自分をそのままアバター化してもテンションが上りません。現実をそのまま仮想空間に持っていっても第2の現実が待っているだけですから。できることなら広瀬すずや橋本環奈のような美人の力を借りて、「美人ってこんな人生なんだな」という体験をしてみたいわけです。違います。仮想空間において「顔も含めて」自在な表現ができたら、自己表現の幅が広がるなと思うわけです。

今回はStyleGANで自分と広瀬すずと橋本環奈を混ぜた顔写真を生成して、さらに3Dアバター化してみました。

参考文献

StyleGAN3

Headshot(Character Creatorのプラグイン)

FaceSwap

顔写真はぱくたその「メイク前のすっぴん女子」を使用させていただきました。感謝します。

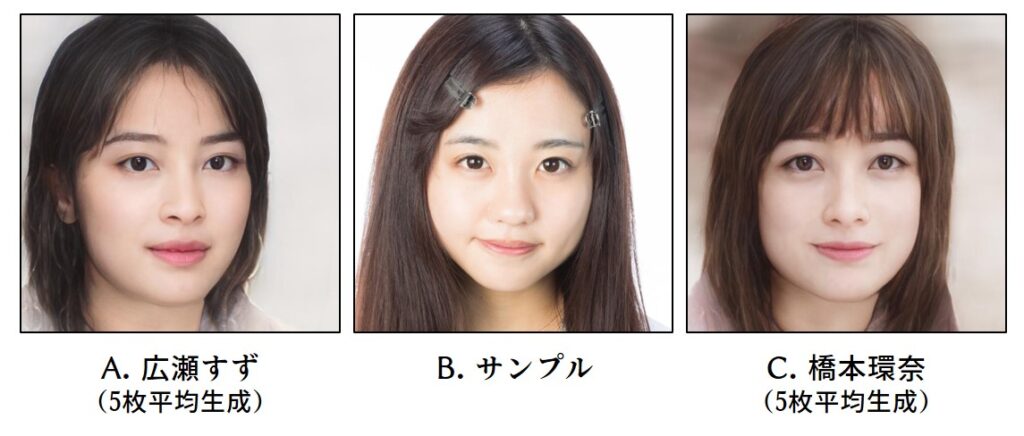

StyleGANで自分と美人を合成する

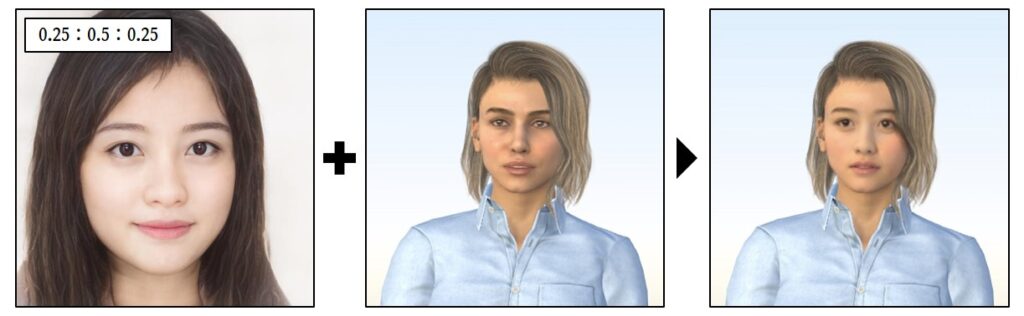

おっさんの顔でやるとブラウザの戻るボタンに手がかかってしまうので、フリー素材を使用させていただきます。広瀬すずと橋本環奈は適当な5枚をStyleGANで平均しておきました。

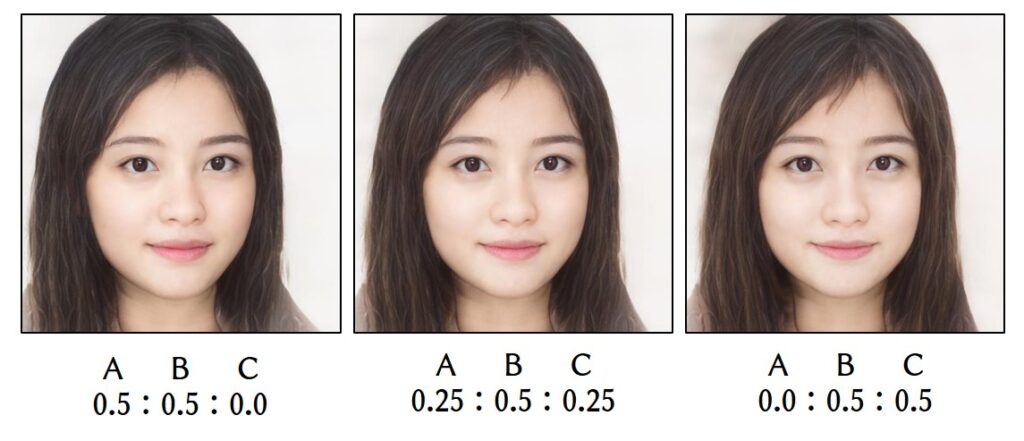

StyleGANで混ぜてみました。

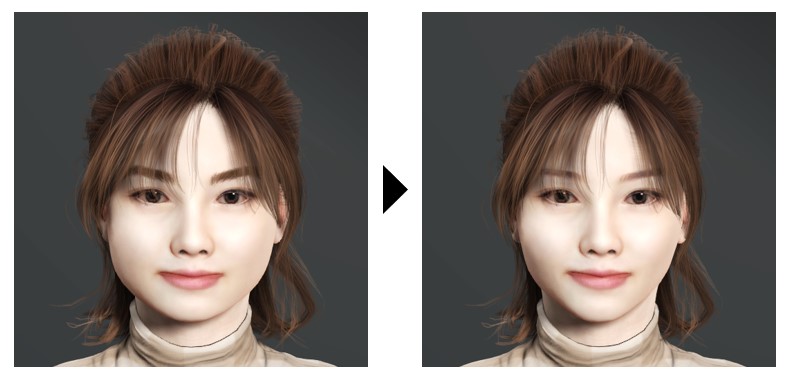

変化は小さいですがよく見ると違いがあります。どうなんでしょう。メイクでこれくらいは印象を変えられちゃいますかね。やっぱりおっさんでやったほうが良かったかも…。

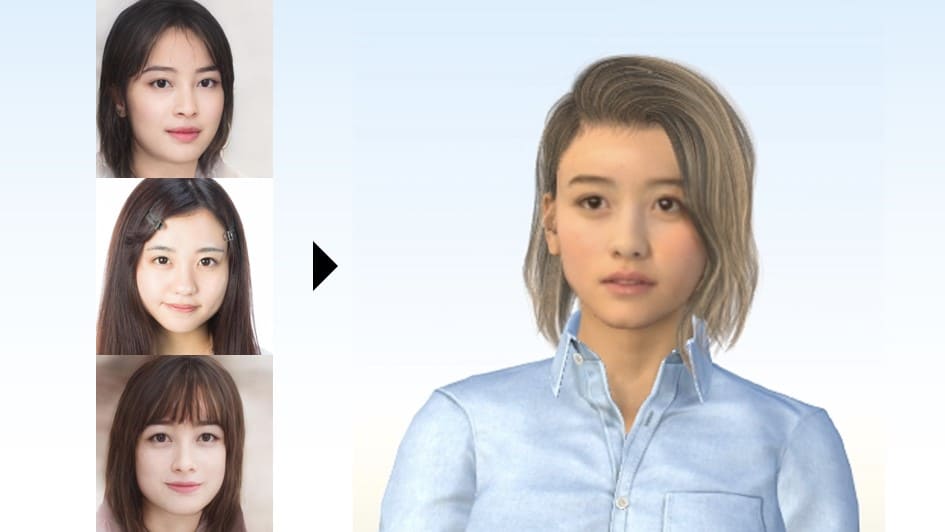

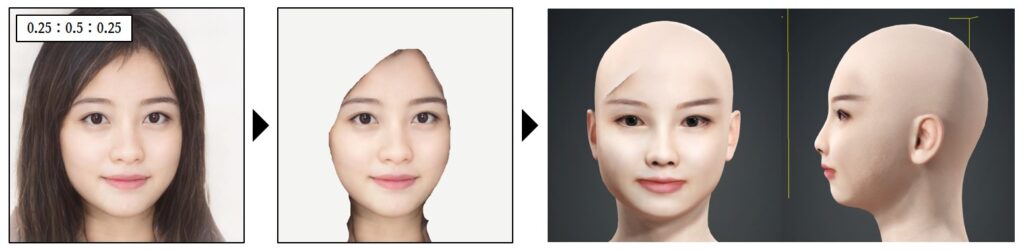

合成写真を3Dアバター化する

顔写真から3D頭部モデルを作成するHeadshot(Character Creatorのプラグイン)に入れてみました。

髪を付けて少し輪郭を手修正してみます。元画像に似たような髪がなかったので適当な髪型を選びました。

どうでしょう。目や眉の印象が違いますし、なんかツヤツヤしていかにもアバターという感じがします。

合成写真をFaceSwapで3Dアバターに貼り付ける

別の方法として、FaceSwapで3Dアバターの画像に貼り付けてみました。(画像的に貼っただけで3Dアバター化したわけではありません)

ちょっと小麦色に焼けたままですが、目元はHeadshotより自然な気がします。肌の色と髪型を修正すれば使えるかも…?アバターを喋らせる動画を作成する場合はこの方法でも行けそうです(所謂DeepFake動画)。

さいごに

一応補足しておきますと、美人が良いとか、ルッキズムな主張を持っているわけではありません。これまではファッション等で自己表現したいと思っても、あくまで「生まれ持った顔」という制約の中でしかできませんでした。それが深層学習と3Dモデルの力を借りることで、顔も含めて表現可能になるわけです。制約があるからこそ価値があるという考え方もあれば、無差別級で自由な表現をしたいという価値観もあるということですね。